인공지능 시대, 윤리적 미로에서 탈출하라!

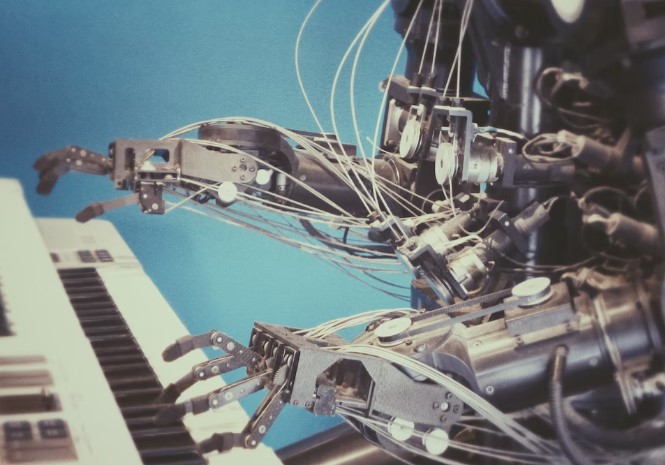

인공지능 기술의 발전으로 우리는 이전에 상상도 못했던 수많은 혁신적인 변화들을 경험하고 있다. 인공지능은 우리의 일상생활을 편리하게 만들어주기도 하고, 새로운 산업을 창출해내기도 하지만, 동시에 윤리적 문제를 일으키기도 한다. 이번 글에서는 인공지능의 윤리적 문제에 대해 살펴보고, 이를 해결하기 위한 방안을 모색해보려 한다.

인공지능의 윤리적 문제

인공지능의 편향성

인공지능이 작동하는 방식은 학습 데이터를 기반으로 한다. 그렇기 때문에 학습 데이터에 포함된 편향성이 인공지능의 결과물에 영향을 미칠 수 있다. 예를 들어, 인공지능이 구성원이 대부분 흑인인 지역에 대한 모니터링 시스템을 만들 경우, 흑인에 대한 양성 편향성이 발생할 수 있다. 이러한 편향성은 이전에도 많은 문제를 일으켰고, 그 중 하나는 얼굴인식 기술을 이용한 인종차별적인 대우가 있었다.

인공지능의 결정권

인공지능이 사람들의 생활에 영향을 미칠 때, 그 결정을 내리는 권한은 누구에게 있을까? 인공지능이 판단을 내리는 것은 사실상 기계적인 알고리즘이지만, 그 결과는 사람들의 삶에 직접적으로 영향을 미치기 때문에 이에 대한 규제와 책임 문제가 제기되고 있다.

개인 정보 보호

인공지능이 대규모 데이터를 수집하고 분석하는 과정에서 개인정보 보호 문제가 발생한다. 특히, 보험사나 은행 등이 개인의 건강 정보나 신용도 등을 수집해 인공지능을 이용해 판단을 내리면서, 이러한 정보들이 악용될 가능성도 존재한다.

인공지능의 윤리적 문제 해결 방안

다양한 데이터 활용

학습 데이터에 편향성이 발생하지 않도록 다양한 데이터를 활용하는 것이 중요하다.

다양한 데이터를 활용하면 인공지능의 결과물에 대한 정확성과 공정성이 높아지며, 특정 집단이나 개인에 대한 차별을 줄일 수 있다. 예를 들어, 얼굴인식 기술을 개발할 때, 다양한 인종, 성별, 연령층의 데이터를 수집하여 학습시키면, 특정 집단에 대한 편견이나 차별을 줄일 수 있다.

인공지능의 투명성

인공지능이 어떤 데이터를 기반으로 어떻게 판단을 내리는지, 그리고 그 판단을 내릴 때 어떤 요소를 고려하는지에 대한 투명성을 높이는 것이 필요하다. 이를 위해서는 인공지능의 동작 원리와 결과물에 대한 설명을 이해하기 쉽게 제공하는 것이 중요하다. 이를 통해 인공지능이 어떤 결정을 내리는지 이해할 수 있으며, 필요한 경우 수정이 가능하다.

인공지능의 책임

인공지능이 내린 결정에 대한 책임을 누구가 져야 하는지에 대한 문제가 제기되고 있다. 이에 대한 해결책으로는, 인공지능을 개발하거나 운용하는 기업이 책임을 질 수 있도록 법적인 규제를 마련하는 것이 필요하다. 또한, 인공지능이 내린 결정에 대한 피해가 발생했을 경우에는 해당 기업이 책임을 지도록 하는 시스템을 구축하는 것이 필요하다.

개인 정보 보호

인공지능이 개인 정보를 수집하고 처리할 때는, 해당 정보를 제대로 보호하고 사용 목적에 맞게 처리해야 한다. 이를 위해서는 법적인 규제나 기업 내부적인 규정 등을 마련하여, 개인 정보 보호에 대한 이슈를 해결하는 것이 중요하다. 또한, 개인 정보를 수집할 때는, 해당 정보의 수집 목적을 명확하게 밝히고, 개인이 동의한 경우에만 수집하는 것이 바람직하다.

인공지능의 발전은 우리의 삶에 많은 혁신적인 변화를 가져오고 있다. 그러나, 인공지능의 사용에는 여전히 윤리적 문제가 많이 존재한다. 이러한 문제들을 해결하기 위해서는 인공지능을 개발하고 운용하는 기업과 개인이 책임감을 가지고 적극적으로 대처해야 한다. 다양한 데이터를 활용하여 편향성을 줄이고, 인공지능의 결정 과정을 투명하게 제공하여 신뢰성을 높이는 것은 물론, 개인 정보 보호와 인공지능의 결정에 대한 책임 문제를 법적으로 규제하고, 적극적인 대처가 필요하다. 이를 통해 우리는 미래 지능화 시대를 보다 건전하고, 지속 가능한 방향으로 이끌어 나갈 수 있을 것이다.

인공지능 장착한 '빙' 기사 바로가기 ◀ 링크

'사회 이슈' 카테고리의 다른 글

| 전국 산불 발생, 그 이유와 대응상황은? (0) | 2023.04.02 |

|---|---|

| ChatGPT 3.5 vs 4.0 : 새로운 멀티모달 AI 기술의 진화 (0) | 2023.03.21 |

| chatGPT 4.0 공개! AI 기술로 혁신적인 미래를 예측하다. (0) | 2023.03.16 |

| 고(故) 전두환 전 대통령 가족의 비극, 손자의 폭로성 발언 (0) | 2023.03.15 |

| 호주 대표팀, WBC 8강 진출 확정... 대한민국은 탈락 (0) | 2023.03.14 |

댓글